Čo je technológia Big Data Technology?

Ako vieme, údaje sa neustále vyvíjajú. Rast údajov vyzýval ľudské mozgy, aby ich extrahovali, analyzovali a riešili. Dôvodom je skutočnosť, že tradičné spôsoby zaobchádzania s údajmi nepodporujú tieto veľké údaje. Veľké údaje opisujú zvyčajne tri koncepcie: objem, rozmanitosť a rýchlosť.

Údaje sa stali najdôležitejšou devízou každej spoločnosti. Analýza týchto veľkých údajov pomáha spoločnosti analyzovať správanie svojich zákazníkov a predpovedať relevantné veci spojené s rozhodnutiami založenými na údajoch, aby organizácia urobila istejšie kroky a vybudovala silnejšie stratégie.

Vďaka veľkému množstvu údajov, ktoré v dnešnej dobe rastú, budú veľké údaje v blízkej budúcnosti obrovským poľom, pre ktoré budú pracovať. Všetci študenti, nováčikovia a odborníci budú potrebovať, aby sa neustále informovali o vznikajúcich technológiách veľkých dát. Udržiavanie sa aktuálneho stavu prinesie skvelú a úspešnú kariéru na profesionálnej ceste.

Veľké dátové technológie

Tu uvádzam niekoľko veľkých dátových technológií s jasným vysvetlením, aby som vás upozornil na nadchádzajúce trendy a technológie:

-

Apache Spark:

Je to rýchly stroj na spracovanie veľkých dát. Toto je zostavené s ohľadom na spracovanie údajov v reálnom čase. Jeho bohatá knižnica Strojového učenia je dobrá na prácu v priestore AI a ML. Spracováva údaje paralelne a na klastrových počítačoch. Základný typ údajov používaný programom Spark je RDD (pružná distribuovaná množina údajov).

-

NoSQL databázy:

Jedná sa o non-relačné databázy, ktoré poskytujú rýchle ukladanie a získavanie údajov. Jeho schopnosť riešiť všetky druhy údajov, ako sú štruktúrované, pološtrukturované, neštruktúrované a polymorfné údaje, je jedinečná. Žiadne databázy SQL nie sú nasledujúcich typov:

- Databázy dokumentov : Uchovávajú údaje vo forme dokumentov, ktoré môžu obsahovať mnoho rôznych párov kľúč - hodnota.

- Grafické obchody : Uchovávajú údaje, ktoré sa zvyčajne ukladajú vo forme siete, napríklad údaje zo sociálnych médií.

- Úložisko kľúč - hodnota : Jedná sa o najjednoduchšie databázy NoSQL. Každá jednotlivá položka v databáze je uložená ako názov atribútu (alebo „kľúč“) spolu s jej hodnotou.

- Obchody so širokými stĺpcami : Táto databáza ukladá údaje skôr v stĺpcovom formáte ako vo formáte riadku. Cassandra a HBase sú dobrými príkladmi.

-

Apache Kafka:

Kafka je distribuovaná platforma na vysielanie udalostí, ktorá každý deň spracováva veľa udalostí. Keďže je rýchly a škálovateľný, je to užitočné pri vytváraní potrubných tokov údajov v reálnom čase, ktoré spoľahlivo získavajú údaje medzi systémami alebo aplikáciami.

-

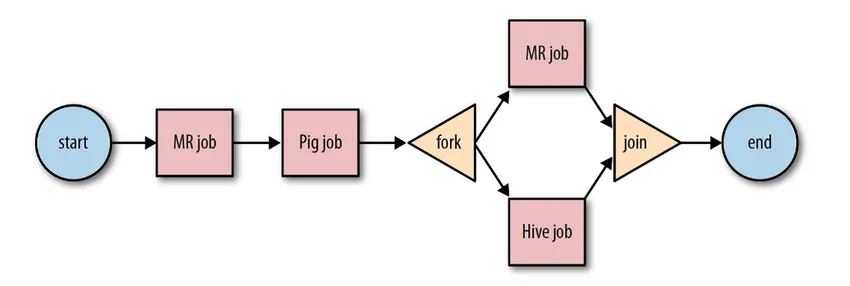

Apache Oozie:

Je to systém plánovača pracovných postupov, ktorý riadi úlohy Hadoop. Tieto úlohy pracovného toku sú naplánované pre akcie vo forme usmernených acyklických grafov (DAG).

Zdroj: Google

Jeho škálovateľné a organizované riešenie pre veľké dátové aktivity.

-

Apache Airflow:

Toto je platforma, ktorá plánuje a monitoruje pracovný tok. Inteligentné plánovanie pomáha pri efektívnom organizovaní ukončenia projektu. Airflow má schopnosť znovu spustiť inštanciu DAG, keď dôjde k zlyhaniu. Jeho bohaté užívateľské rozhranie uľahčuje vizualizáciu potrubí, ktoré bežia v rôznych fázach, ako je výroba, monitoruje priebeh a v prípade potreby rieši problémy.

-

Apache Beam:

Je to zjednotený model na definovanie a vykonávanie potrubí na spracovanie údajov, ktoré zahŕňajú ETL a nepretržité streamovanie. Rámec Apache Beam poskytuje abstrakciu medzi vašou aplikačnou logikou a ekosystémom veľkých údajov, pretože neexistuje žiadne API, ktoré by viazalo všetky rámce ako Hadoop, iskra atď.

-

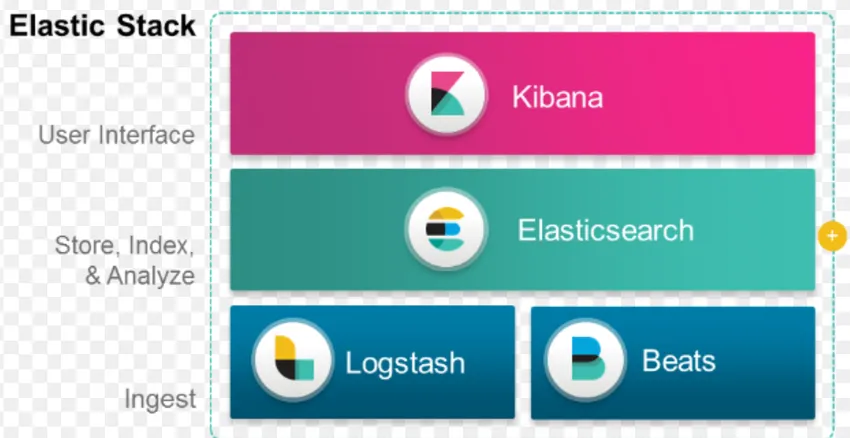

Zásobník ELK:

ELK je známy pre Elasticsearch, Logstash a Kibana.

Elasticsearch je databáza bez schém (ktorá indexuje každé pole), ktorá má výkonné možnosti vyhľadávania a ľahko škálovateľnú.

Logstash je nástroj ETL, ktorý nám umožňuje načítať, transformovať a uložiť udalosti do Elasticsearch.

Kibana je nástroj dashboardingu pre Elasticsearch, kde môžete analyzovať všetky uložené údaje. Praktické informácie získané z Kibany pomáhajú pri budovaní stratégií organizácie. Od zachytávania zmien k predikcii sa Kibana vždy osvedčila ako veľmi užitočná.

-

Docker & Kubernete:

Toto sú vznikajúce technológie, ktoré pomáhajú aplikáciám bežať v kontajneroch Linux. Docker je zbierka nástrojov s otvoreným zdrojovým kódom, ktoré vám pomôžu zostaviť, odoslať a spustiť ľubovoľnú aplikáciu kdekoľvek.

Kubernetes je tiež platformou s otvoreným zdrojovým kódom / orchestračnou platformou, ktorá umožňuje veľké množstvo kontajnerov spolupracovať v harmónii. To nakoniec zníži prevádzkovú záťaž.

-

TensorFlow:

Je to otvorená knižnica strojového učenia, ktorá sa používa na navrhovanie, vytváranie a školenie hlbokých modelov učenia. Všetky výpočty sa uskutočňujú v TensorFlow s grafmi toku údajov. Grafy obsahujú uzly a hrany. Uzly predstavujú matematické operácie, zatiaľ čo hrany predstavujú údaje.

TensorFlow je užitočný pre výskum a výrobu. Bol postavený s ohľadom na to, že môže bežať na viacerých procesoroch alebo GPU a dokonca aj na mobilných operačných systémoch. Toto by sa mohlo implementovať v Pythone, C ++, R a Java.

-

Presto:

Presto je open source SQL engine vyvinutý spoločnosťou Facebook, ktorý je schopný spracovať petabajty údajov. Na rozdiel od Hive, Presto nezávisí na technike MapReduce, a teda rýchlejšie pri získavaní údajov. Jeho architektúra a rozhranie sú dostatočne ľahké na interakciu s inými súborovými systémami.

Vďaka nízkej latencii a ľahkému interaktívnemu dopytu je v dnešnej dobe veľmi populárny pri spracovaní veľkých dát.

-

Polybase:

Polybase pracuje nad SQL Serverom na prístup k údajom uloženým v PDW (Parallel Data Warehouse). PDW postavený na spracovanie ľubovoľného objemu relačných dát a poskytuje integráciu s Hadoop.

-

Úľ:

Úľ je platforma používaná na dotazovanie a analýzu údajov na veľkých množinách údajov. Poskytuje dotazovací jazyk podobný SQL s názvom HiveQL, ktorý sa interne prevedie na MapReduce a potom sa spracuje.

Vďaka rýchlemu rastu údajov a obrovskej snahe organizácie o analýzu veľkých dát priniesla technológia na trh toľko vyspelých technológií, že ich znalosť je obrovským prínosom. V súčasnej dobe spoločnosť Big Data Technology rieši mnohé obchodné potreby a problémy zvýšením prevádzkovej efektívnosti a predpovedaním príslušného správania. Kariéra v oblasti veľkých dát as ňou súvisiacich technológií môže človeku i podnikom otvoriť mnoho príležitostí.

Od tejto chvíle je najvyšší čas prijať veľké dátové technológie.

Odporúčané články

Toto bol sprievodca What is Big Data Technology. Tu sme diskutovali o niekoľkých veľkých dátových technológiách, ako sú Hive, Apache Kafka, Apache Beam, ELK Stack, atď. Ďalšie informácie nájdete v nasledujúcom článku -

- Čo je to Deep learning?

- Sprievodca po Minitabe?

- Čo je technológia Salesforce?

- Čo je to veľká dátová analytika?